Ausgangssituation & Zielsetzung

Hochschulen stehen vor der Herausforderung, KI sinnvoll einzusetzen, ohne dabei:

- sensible Daten aus der Hand zu geben,

- sich an proprietäre SaaS-Plattformen zu binden,

- oder langfristige Abhängigkeiten von einzelnen Anbietern einzugehen.

Ziel des Projekts war daher der Aufbau einer modularen, selbst betriebenen KI-Plattform, mit der:

- unterschiedliche Sprachmodelle je Anwendungsfall genutzt werden können,

- interne Wissensbestände sicher eingebunden werden,

- und KI-Anwendungen flexibel erweitert werden können.

Technische Umsetzung

Die Lösung wurde vollständig auf eigener Infrastruktur umgesetzt und produktionsnah getestet.

Systemarchitektur

- Betriebssystem: Ubuntu Linux (LTS)

- Containerisierung: Docker

- Reverse Proxy: NGINX (TLS, Routing, Zugriffskontrolle)

- Hardware: Dedizierte Server inkl. GPU-Server

- Betriebsmodell: Self-hosted, keine geteilte Cloud

Alle Daten und KI-Verarbeitungen verbleiben innerhalb der kontrollierten Systemumgebung.

Multi-LLM-Ansatz: Lokale und externe Sprachmodelle

Ein zentrales Element des Projekts ist der Multi-LLM-Betrieb.

Lokale Sprachmodelle (On-Premise)

Folgende Modelle wurden erfolgreich auf eigener GPU-Infrastruktur angebunden:

- LLaMA 3

- Mistral 7B

- Gemini (lokale Variante)

- gpt-oss:20b

Diese Modelle verarbeiten sämtliche Daten ausschließlich lokal, ohne externe Weitergabe.

Externe Modelle (optional)

- ChatGPT über API-Anbindung

Der Einsatz externer Modelle erfolgt gezielt für weniger sensible Anwendungsfälle oder Vergleichszwecke.

➡️ Das jeweils eingesetzte Modell kann pro Use Case ausgewählt und jederzeit gewechselt werden.

Wissensbasierte Chatbots mit AnythingLLM

Strukturierte Wissensräume (RAG)

Mit AnythingLLM wurden mehrere Workspaces aufgebaut, die jeweils eigenes Wissen enthalten, z. B.:

- interne Dokumente

- Richtlinien

- organisatorische Informationen

Die Antworten basieren auf Retrieval-Augmented Generation (RAG):

- gezielte Nutzung hinterlegter Inhalte

- reduzierte Halluzinationen

- nachvollziehbare Informationsbasis

Einbettung in Webseiten

Einzelne Workspaces wurden als Chatbots für Webseiten bereitgestellt, z. B.:

- Informations-Chatbots

- Service- oder Support-Assistenten

Interne und externe Anwendungsfälle sind dabei klar getrennt.

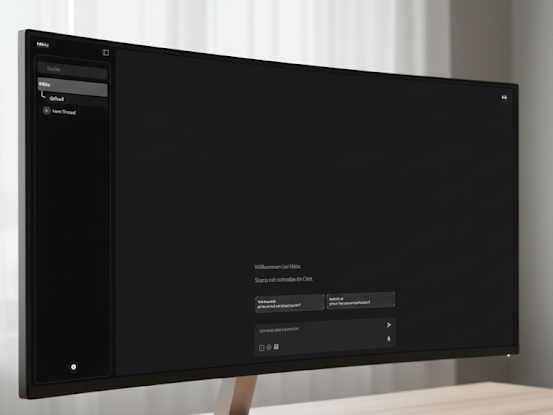

Zentrales KI-Frontend mit Open WebUI

Single Sign-On & Benutzerverwaltung

- Anbindung an Microsoft Entra ID

- Authentifizierung über OAuth2 / OpenID Connect

- Zentrales Single Sign-On (SSO)

Damit wird eine kontrollierte Nutzung über bestehende Identitätsstrukturen ermöglicht.

Einheitliche Benutzeroberfläche

Open WebUI dient als zentrales Frontend für:

- unterschiedliche Sprachmodelle

- wissensbasierte Abfragen

- experimentelle und produktive KI-Anwendungen

Vorteile gegenüber proprietären SaaS-Plattformen

Keine Anbieterabhängigkeit

- Einsatz offener Standards und Open-Source-Komponenten

- Kein Vendor-Lock-in

- Einzelne Komponenten jederzeit austauschbar

Volle Datenhoheit

- Alle Daten verbleiben auf eigener Infrastruktur

- Keine Weitergabe an Dritte

- Keine geteilten Mandantenumgebungen

Transparente Kosten

- Planbare Kosten für Hardware und Betrieb

- Optionale API-Nutzung nur bei Bedarf

- Keine nutzer- oder featureabhängigen Lizenzmodelle

Hohe Anpassbarkeit

- Eigene Domain und Corporate Design

- Integration in bestehendes SSO

- Individuelle Rollen, Chatbots und Wissensräume

Zukunftssicherheit

- Modular erweiterbar (neue LLMs, Tools, Use Cases)

- Investitionssicherheit durch offene Architektur

- Unabhängig von einzelnen Herstellern oder Plattformen

Projekt-Features im Überblick

- Multi-LLM-Betrieb (lokal & cloudbasiert)

- Hochschuldokumente als Wissensbasis (RAG)

- Eingebettete Chatbots für Webseiten

- Single Sign-On (Microsoft Entra ID)

- Self-hosted Betrieb mit Docker & NGINX

- Lokale Bildgenerierung und Bildverständnis (Vision-Modelle)